Last updated 2002.12.1 Sun.

人間形頭部ロボット WE-3RV

1. 研究目的

本研究では,人間形頭部ロボットの開発を行うことによって,人間の知覚・認識機能を工学的観点から解明し,人間との円滑なコミュニケーションを可能とするために必要なロボットの形態と機能の実現を目標としています.2002年,高西研では人間形頭部ロボットWE-3RV (Waseda Eye No.3 Refined V)を開発しました.

2. ロボットシステム

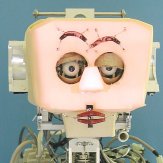

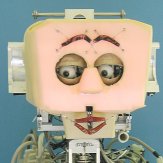

WE-3RVの写真はFig. 1,Fig. 2の通りです.WE-3RVは28自由度(首:4,眼球:4,眼瞼:6,眉:8,口唇:4,顎:1,肺:1)を有しており,外部からの刺激に対する感覚器官として,多種のセンサ(視覚,聴覚,触覚,嗅覚)を搭載しています.順番にそれぞれについて詳しく説明していきます.

|

|

|

Fig. 1 WE-4 (全体図)

|

Fig. 2 WE-4 (頭部)

|

2.1 首部

首部は4自由度を有し,各軸とも人間と同等である160[deg/s]で動くことができます.ヨー軸はハーモニックドライブ減速機を用いた直接駆動,他の3軸はDCモータ,ばね拮抗のワイヤ駆動方式になっています.

2.2 眼球・眼瞼部

眼球部は4自由度を有し,最大角運動速度は眼球部600[deg/s]と人間と同等の運動性能を有しています.

眼瞼部は6自由度を有し,上瞼・下瞼の開閉に加え,上瞼を回転させることで目尻の上げ下げによる情動表出を可能としました.眼瞼開閉の最大角速度は900[deg/s]であり,人間と同等になっています.さらに,人間と同じように0.3[s]以内の瞬目が可能です.

2.3 表情表出機構

WE-3RVは眉・口唇と顔色を用いた表情表出が可能です.眉と口唇は樽形バネをステッピングモータで引っ張ることで表現しています.

顔色には赤色と青色の2枚のEL(Electro Luminescent)シートと重ね合わせることで,2色の顔色を実現しています.ELシートとは薄膜,軽量で,力を感知するFSR(Force Sensitive Resister)のような他のセンサの動作に影響を与えないデバイスです.これを額,目の周り,頬および鼻梁の4箇所に配置しています.

2.4 発声システム

WE-3RVは表出する表情の効果をより強めるために,声を発することができます.そのため,ロボットが話す言葉には特定の意味を持たせておらず,むしろ音に近くなっています.発声システムにはオーディオ用のアンプとスピーカーを使用し,チューブを使ってロボットの頭部まで音を伝達することで,ロボット上にスピーカーを載せることなく頭部から発声させることを可能にしています.

2.5 皮膚システム

人間がロボットに触れる際の親和性の向上のため,ロボットの皮膚として人間の皮膚と同程度の柔らかさを持つ透明なゲルを貼り付け,その表面に人間の皮膚に近い触感の肌色シリコンゴムを被せています.WE-3RVの皮膚では入力・出力・感触の3つの機能を実現しました.

2.6 センサ

(1) 視覚

視覚センサとしては,両眼にカラーCCDカメラを搭載し,重心演算ボードおよび輝度算出ボードを用いて画像処理を行っています.重心演算ボードは2枚用いており,両眼のCCDカメラの画像が入力されます.これにより,電球などの視標を追従させること,視標の位置を知ることができます.輝度算出ボードには左眼のCCDカメラの画像が入力され,光強度に対する適応を実現しています.

(2) 聴覚

耳部に聴覚センサとして,コンデンサマイクを搭載しています.音の大きさと,左右の音圧差から音源の方向を感知できます.

(3) 触覚

WE-3RVは皮膚感覚として,触・圧覚と,温覚を搭載している.触・圧覚センサには,FSR(Force Sensing Resistor)を使用し,温度センサとして,CMOSセンサICを搭載しています.

FSRは非常に弱い力でも検出が可能であり,薄くて軽量なデバイスです.われわれは,2枚のFSRを重ねて貼ることにより,力の大きさのみでなく,触れ方の違いを検出することを可能としました.

(4) 嗅覚

われわれは,嗅覚センサとして4種類の半導体ガスセンサを使用しています.4種のセンサはロボット背部のセンサBOXに納め,鼻と肺の間はホースを用いて接続しました.肺部は4組のシリンダとピストンからなり,それらをDCモータで駆動してます.WE-3RVは「アルコール」,「アンモニア」,「たばこの煙」の3種類においを識別可能です.

2.7 システム構成

人間形頭部ロボットWE-3RVのシステム構成はFig. 3のようになっています.ロボットの制御には,2台のパーソナルコンピュータ(PC/AT互換機)を使用しており,それらはお互いにEthernetにて接続されています.

PC1では,ロボットの視覚処理と心理モデル・ロボットパーソナリティに基づいてロボットの情動を決定をおこなっています.そして,それらの情報をPC2に送っています.PC2ではPC1から送られてきた視覚情報と心理情報に基づいて,眼球・眼瞼・顎・肺部のDCモータの制御,表情,顔色の制御を行っています.さらに,聴覚,触覚,嗅覚センサからの情報取得と刺激の識別をおこない,それをPC1に送信しています.

Fig. 3 システム構成図

3. 表情表出

WE-3RVは表情や首部の運動,声によって自分の感情を表現します.われわれは表情の制御において,Ekmanの6基本表情を採用しており,"喜び","怒り","驚き","悲しみ","恐れ","嫌悪"の6つの情動に対応する表情に"通常状態"を加えた7つの表情パターンをあらかじめ定義しています.そして,各部の変位を"通常状態"との間で50段階に線形補間し,情動の強さと各部の動きの大きさを対応させることで,どのような情動であってもそれに対応した表情表出を可能としています.

WE-3RVに定義している基本表情をFig. 4に示します.さらに,WE-3RVでは,従来の基本表情に加え,Fig. 5のような"酔い"や"羞恥"といった新しい表情も表現可能となりました.

4. 心理モデル

WE-3RVは多感覚・表情表出機能だけでなく,心理モデルを持っており,入力された刺激に従って,刻一刻と感情を変化させていきます.そして,その感情を表情や顔色,首の動きなどによって表現します.さらに,人間はひとりひとり性格が異なっているように,ロボットにもパーソナリティを導入することで,個性を持たせようとしています.ロボットパーソナリティは感受個性と表出個性からなり,前者は外界からの刺激がいかに感情に作用するかを,後者は感情をどの程度表出するかを決定しています.ロボットの心理モデルの流れはFig. 6のようになっています.

Fig. 6 心理モデルとパーソナリティ

WE-3RVの心理モデルとしては,Fig. 7のような3次元の心理空間を定義しており,心理空間内に定義した情動ベクトルMによってロボットの心理状態は表されます.外部から刺激が入力されると,ロボットの心理状態である情動ベクトルMは,情動方程式と呼んでいる方程式に従って変化していきます.さらに,ロボットの心理空間に対して,Fig. 8のように7種類の感情をマッピングして

Fig. 7 心理空間

Fig. 8 感情マッピング